イベント

「あなたの耳」専用の3D音響でお届けするAIベースのサウンド処理技術「Embody」

|

これは,耳にやってきた音波が,耳の中の鼓膜を振動させる前に,耳殻(じかく)によって変調されることが大きな要因となっている。耳殻とは,頭部左右から突き出た丸みを帯びた板状の部位で,日常生活で単に「耳」と呼ばれる部分だ。

前述したように,耳にやってきた音は,この耳殻に衝突して反射,あるいは回折などの現象を経て鼓膜に到達するのだが,音源と聴者の相対的な位置関係,方向によって音の変調のされ方が変化する。人間はこの変調された音波の特質を感じ取って音の360度定位を知覚しているのだ。

昨今では,この耳殻形状と360度音像定位の関係をバーチャルサウンド技術に結びつけた新音響技術の発表が続いている。

たとえば,SoundBlasterブランドで有名なCreative Technology(以下,Creative)が,スマホなどで撮影したユーザーの耳殻の形状から正確な360度音像定位を実現する3Dホログラフィックスサウンド技術「Super X-Fi」をCES 2018で発表発表しており,2019年1月のCES 2019では対応するUSBサウンドデバイスやヘッドセットも登場した。

CES 2019ではソニーが「360 Reality Audio」を発表したが,これも聴者の耳殻に合わせた最適化のために,スマートフォンで撮影した耳の写真を利用することが可能な技術である。

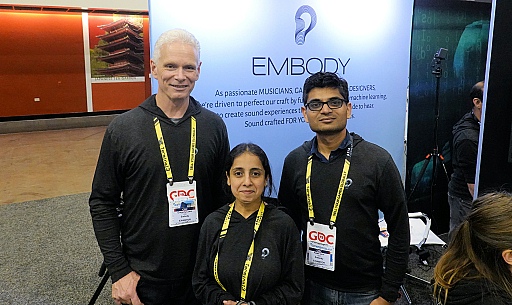

GDC 2019の展示でも,同種のサウンド技術を扱う新興企業「Embody」がブースを構えており,業界関係者の間で話題になっていたので紹介したいと思う。

|

耳殻形状と,その音波変調特性の関係を機械学習させて360度音像定位変調関数を生成するImmerse技術

|

彼らが開発した技術「Immerse」も冒頭で挙げたような,ユーザーごとに最適化した360度音像定位を提供するものである。

Immerseのパイプラインは,

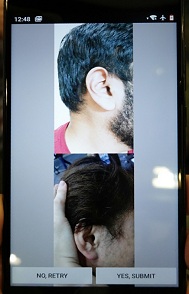

- 撮影されたユーザーの耳殻の写真から耳殻モデルを構築

- その耳殻モデルをもとにした360度の音像定位を変調する関数的なものを生成

- 以降は,この関数に対して,音波をX,Y,Zの3次元座標と方向などの情報と共に入力してやると,その耳殻モデルによって変調された音波が出力される

という構成であり,それ自体はCreativeやソニーのものとよく似ている。創設者のShruti Badhwar氏は語る。同氏によれば,この2.の部分に対して機械学習の技術を用いているとのことだ。

どういうデータ群を機械学習させたのかというと,「耳殻の形状」と「音波の変調特性」の関係性だとのこと。これを膨大な量で学習させ,その結果として抽出された学習データから推論モジュールを構成する。つまり,耳殻形状が確定できると,処理対象の音波の情報が入力されたときに,その耳殻で変調された波形を得られるシステムが構築できたというのである。いうなれば,彼らの変調関数とは,その機械学習から得られた推論モジュールそのものというわけである。

Badhwar氏によれば,Immerseの推論モジュールの演算負荷はそれほど高いものではなく,畳み込み演算が高速に行えるプロセッサ環境であれば種類を選ばないとのこと。具体的には,SIMD命令対応のPC向けCPUやスマートフォンのSoC,PC向けGPUで処理できるということだ。なので,Badhwar氏はImmerseをハードウェア製品ではなく,ソフトウェア製品として提供することに主眼を置いていると述べていた。

なお,上記1. 2.の部分はEmbodyが用意したクラウドサーバーで処理される。

つまり,ユーザーの耳殻写真は,クラウド側のEmbodyサーバーに送られたあとで3Dモデル化され,この耳殻モデルからユーザーの耳に最適化された360度音像定位の変調関数(=推論モジュール)を動かすためのパラメータが算出されてクラウドから返ってくるという流れとなっている。

|

|

そして,現在の実装では,Embodyアカウント的なユーザーアカウントを作成すれば,そのユーザーに最適化された変調関数のパラメータは,そのアカウントに紐付けられてサーバー側に保存される仕組みとなっている。なので,一度,アカウントを作ってサーバー側にデータを保存してしまえば,別のマシン環境でImmerseを利用する場合でも,手持ちのアカウントでログインすれば自分専用の変調関数をすぐに利用できる。

背後への正確な定位感と高分解能な上下定位

Immerseは,聴者を原点(中心)に据えた前後左右上下それぞれ360度,任意の座標に音像を定位させて音を再生する,いわゆる「オブジェクトベースサウンド」に対応できるポテンシャルを持つ。なので「Dolby Atmos」や「DTS:X」といったフォーマットに対応することが可能だ。

そしてオブジェクトベースサウンド対応ができるならば,当然,スピーカー位置に依存した旧来の5.1Chとか7.1Chといった「チャンネルベースサウンド」にも対応することができる。

|

現在,EmbodyはImmerse技術を活用したWindows環境向けのサウンドドライバソフトウェアを開発済みで,ブースではさまざまなコンテンツで彼らの360度音像定位を楽しむことができた。

筆者も,実際に,耳の撮影を行って自分専用の変調関数を取得して,ブース内の各コンテンツの聴感を確かめてみた。再生に使われたヘッドフォンは市販のもので,特別なものではない。Jain氏によれば,常識的な再生性能を持つ製品であれば,インナー型,オーバーイヤー型,オンイヤー型,種類も問わず,どんなイヤフォン,ヘッドフォンでもよいとのことだ。

|

上記のゲームすべてでImmerse技術をオン/オフした状態の聞き比べをしたのだが,確かに360度の定位感が明解で面白い。そして音像の背後への回り込み感にはとくに驚かされた。

こうした「ステレオヘッドフォンでサラウンドを再現する仮想音源モノ」は,自分を中心にして一定距離の円軌道で音像が動いている状況で,背後に回った音像の距離感が曖昧になってしまうことが多かった。平易にいえば背後の定位感が掴みにくくなることが多かったのだ。しかし,Immerseの場合,背後に回った音像の定位感がクリアなのだ。背後に回った音像の遠近感が分かるのである。

|

続いて体験したのは,Immerseのフルポテンシャルを体験できる「オブジェクトベースサウンド」のデモだ。

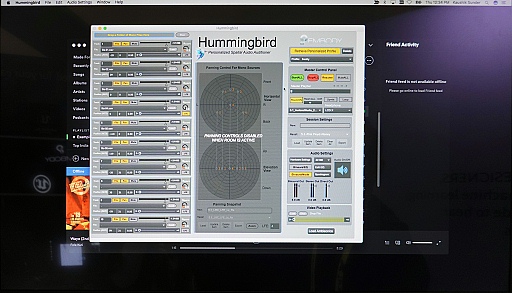

具体的にはDAW(Digital Audio Workstation) Pluginの形態でEmbodyが提供している「SpatialMix」の体験デモになる。

SpatialMixは,音楽制作ソフトにおける各トラックの再生の音像定位を,前後左右上下,360度任意の位置に設定することができるだけでなく,音像定位の移動シーケンスまでを作り込めるミキサーだ。例えば,ピアノのメロディトラックを,頭上から下がりながら右側方を通過して背後に回るような,動きのある定位を与えることができるのだ。

これにはゲームのデモよりも驚かされてしまった。背後の定位感の明瞭さは,もはや当然として,なにより細かい音像のエレベーション(上下移動)表現が再現できているたのだ。

例えばギターの音色が,つま先に定位したり,そこから肩の高さまで上昇していくような表現をちゃんと聴感として得られるのである。

ヘッドフォンで音楽を聞くと,すべての楽器で定位感として左右の分離感は感じられても,ほぼ全部の楽器が混ざり合って聞こえると思うが,Spatial Mixを使うと,各楽器が聴感として独立して聞こえるのが感動的であった。

|

最後に体験したのはVRゲーム「In Flow」だ。

In Flowは,Rodolphe Parfait氏率いるインディゲーム開発スタジオNoosensartとEmbodyが共同開発しているVRゲームで,Immerse技術のショーケースの役割を担う作品といえる。ジャンル分けが難しいが,In Flowは一種の音楽アクションゲームといっていいだろう。

●InFlow公式動画

プレイヤーはHTC製のVRHMD「Vive」を被り,左右の手にはViveコントローラを一つずつ持ってプレイをする。ゲームは一人称視点で,幻想的な空間を奥へ奥へと進んでいく飛行タイプだ。耳に付けたヘッドフォンからは女性ボーカリストが歌うポップソングが聞こえ,そのリズムに合わせて脈動するパーティクルがプレイヤーの前を通り過ぎ,背後に消え去っていく。

曲が進行していくと,そのリズムの拍子と同期する感じで,照準器のような円が出現しては小さく縮んでいくのだが,この拍子(=円の収縮周期)に合わせて左右の手に持ったViveコントローラ上のボタンを押しながら腕を振ると,その腕の軌跡に合わせて新体操のリボンのような帯状のパーティクルが出現するのだ。

プレイヤーが身体を回転させつつ腕を振れば,この帯はプレイヤーの前後左右上下にまとわりつく。

|

ここでプレイヤーは,自らが作り出したこのリボンが,その時点で鳴っている楽器トラックの一つ一つに相当することに気がつく。たとえば,ボーカルトラックに対応するリボンを自分の身体にまとわりつくように軌跡をコントロールすれば,その軌跡のとおりに女性ボーカルの声が自分の身体の周りを動き回る。女性ボーカリストの歌声がリボンに姿を変えてしまったような感覚と言えば伝わるだろうか。

前出のSpatial Mixのデモを,よりゲーム的に,なおかつ視覚的にまとめ上げたようなリズムゲームだ。楽曲の各演奏トラックが視覚化されて,自分の身体を走り抜けていくような感覚が実に気持ちよかった。

|

この感覚は,「Rez」や「Child of Eden」を手がけた水口哲也作品に近いモノを感じたのだが,ブースにいたParfait氏にそう伝えると「実はこの作品は尊敬する彼の作品から影響を受けているんだ」と嬉しそうに答えていた。

日本でのビジネス展開も決定

現在はWindows用のサウンドドライバソフトウェア以外に,Unreal Engine用のプラグインや,Googleの3Dオーディオ技術「Resonance Audio」に対応したSDKなども完成しているそうで,Immerse技術をゲームプログラム側に統合して利用できるようになっているという。汎用性の面からすると,今回出展されていたWindows用のサウンドドライバ(≒ソフトウェアベースのサウンドプロセッサ)としての活用のほうが人気は出そうだが,In Flowのような映像の動きと音像定位を正確にシンクロさせたいならば,ゲームプログラムとImmerseを統合させるアプローチのほうがいいのだろう。

なお,このImmerse技術のライセンス供与に関して,国内においては,半導体メーカーのマクニカ傘下のクラビス・カンパニーが担当することになったそうだ。

VRなどではとくに360度の定位感が重要になるため,今後,そう遠くない未来にEmbodyの技術をそうした分野のコンテンツで目にする……いや耳にするようになるかもしれない。

- この記事のURL: