イベント

GTC 2017のVR展示ブース「VR Village」で,将来の360度ビデオ技術やNASAが手がける「Hybrid Reality」を体験してみた

|

あくまでも私見だが,NVIDIAは,GTC(GPU Technology Conference)というカンファレンスのメインターゲットを,大口顧客となりつつある機械学習用AIや自動運転といった分野に関心を持つ層に変えていきたいという思惑があるのではないだろうか。

しかし,そうはいってもGPUというプロセッサは,グラフィックス処理を行うものであり,そこに高い関心を持つ来場者は今でも多い。とくにNVIDIAは,ノンゲーム系への発展も期待できる仮想現実(以下,VR)分野には力を入れており,VR関連の展示にもそれなりに大きなスペースを確保する必要がある。その結果として,AIとは別の場所にVRブースを展開することになったのだろう。

そういうわけで本稿では,「VR Village」と名付けられたNVIDIAのVR関連展示ブースでチェックした,注目の展示をまとめてレポートしよう。

高品質の360度ビデオをリアルタイム合成

VRWorks 360 Video

|

VRWorksには,さまざまな機能があるのだが,今回紹介するのはVRゲーム向けというより,いわゆる360度ビデオ用の機能「VRWorks 360 Video」である。これは,円周上に並べた最大32台のカメラで撮影した映像を,ほぼリアルタイムに360度ビデオとして合成するシステムだ(関連リンク)。

今までにも何度か,開発途中のβ版をイベントで公開してきたこの機能が,2017年7月にようやく正式リリースとなるそうだ。

同一メーカー製で同一のレンズを搭載するカメラであっても,微妙に個体差はあるし,撮影環境の光や影といった諸条件によって,カメラごとの露出設定といった撮影時の撮影パラメータが変わってしまうのは,360度ビデオを撮影するときの課題である。たとえば,120度の画角で撮影できるカメラを隣り合わせに配置して,約240度(120度×2)の範囲を撮影したとしても,2台のカメラで撮影した映像の境界付近は,色も明るさも違ってしまう。また,カメラの高さや傾きが微妙に違っていると,2つの映像を並べたときの不連続感が強まってしまうものだ。

複数台のカメラで撮影した映像を合成する処理のことを「スティッチング」というが,これを完全自動,かつリアルタイムに行おうというのが,VRWorks 360 Videoの提供する主な機能である。

|

VRWorks 360 Videoでは,NVIDIAのGPGPUプラットフォームである「CUDA」で構築したコンピュータビジョン技術が活用されている。これによって,隣接する映像の境界がシームレスにつながるように,素材の映像に対する変形や,回転(傾け),色調整までを自動的に調整して,1つのビデオストリームにまとめられるのだ。

入力映像のストリーム数(=撮影カメラ台数)や解像度,フレームレートに応じて,処理性能は当然変わってくるが,マルチGPUに対応しているため,システムに搭載したGPUの数が多ければ多いほど,VRWorks 360 Videoはスケーラブルに性能が向上すると,NVIDIAの説明員は解説していた。なお,現在はMaxwell世代以降のGPUが必須で,対応OSも64bit版Windowsのみとのこと。OS X版やLinux版は,今のところ開発の予定がないそうだ。

ブースでは,VRWorks 360 Videoの最新版デモも披露されていた。

これまでのβ版では,2Dの360度ビデオをリアルタイムでスティッチングすることが可能だったが,今回披露されたリリース版に近いものでは,3D立体視が可能な360度ビデオをリアルタイムにスティッチングできる「Stereo mode」(3D立体視モード)を実装するという。

撮影に使ったカメラは,中国のカメラメーカーであるShenzhen ImagineVision Technologyの新作「Z Cam V1 Pro」(以下,V1 Pro)だ。V1 Proは,円周上に8基,天頂部に1基の4K解像度撮影カメラを搭載したマルチビデオカメラシステムである。ただ,1つ1つのカメラは,ごく一般的な2D映像用だ。しかし,複数のカメラが撮影した2Dのマルチ映像ストリームから,任意の視線方向を向いた3D立体視用の映像ストリームを合成できるのである。

|

カメラが2Dの映像しか撮れなくても,隣接するカメラの撮影領域を大きめにダブらせれば,視差のある情景を撮影することはできる。人間の目で考えると,右目は右端,左目は左端に寄せた状態で見ているようなもので,これを違和感のない映像に補正する処理を,VRWorks 360 Videoの3D立体視モードが行うというわけだ。

筆者も体験してみたが,VR HMDの表示解像度を大きく超える高品質な360度ビデオが目の前に広がる様子には,ちょっと感動した。リコーの360度ビデオカメラ「THETA」のコンテンツをたびたび見ていたこともあり,最近は360度ビデオにもいささか食傷気味だったのだが,このデモはまったく別モノという印象を受ける。どの方向を見ても鮮明かつ高解像度で,継ぎ目が見えることなもく,それでいて立体的に見えるのだ。

|

|

3D立体視のブームは去ってしまったが,360度ビデオとライブ放送を3D立体視に組み合わせることで,また新たな用途が生まれそうな気もする。今後の活用に期待したい。

Lytroのライトフィールド技術を使った自由度の高いVR映像を体験

「ライトフィールドカメラ」というものを製造しているカメラメーカーのLytro(関連リンク)を知っているだろうか。筆者によるSIGGRAPHレポートやGTCなどで,何度か取り上げたことのある企業だ(関連記事)。

|

|

NVIDIAの協力を受けて開発を進めているLytro Immergeは,おおざっぱに言えば「実写系VRコンテンツの制作パイプライン」といったところか。目標としているのは,「直径約1mの球状空間内であれば,ありとあらゆる角度,方向,位置から見ても,視点からの正しい3D立体視の実写映像が見える」というものだそうで,掲げた目標はかなり難度の高そうなものだ。

先述したVRWorks 360 Videoの展示は,静止した立ち位置から見る3D立体視の360度ビデオだったが,撮影するカメラは水平に並べて撮影しているので,理想的な3D立体視ができるのは,ユーザーが目の水平位置を保った状態で首を動かして見る場合だけだ。首を斜めに傾けてしまうと,途端に視差が得られなくなり,変な見え方になる。当然ながら被写体に近寄ったり,しゃがんでから見上げて覗き込んだりといったことはできない。撮影はカメラを動かさずに一点からしか行っていないのだから,それも当たり前だ。

だが,Lytro Immergeが目指すライトフィールドVRとは,それを可能にする技術なのである。

首を傾けても正しい立体映像が見えるうえ,近づいてもしゃがんで見上げてもOK。3D CGで映像を描くVRゲームのような体験を,実写の360度ビデオで可能とするプロジェクトなのだ。Lytroではこれを,「6軸自由度の視体験に対応した実写360度ビデオ」と説明している。

GTC 2017のVR Villageで披露されたのは,Lytro Immergeのα版ともいうべきコンテンツの「Hallelujah」(ハレルヤ)だ。これは,2017年4月末にニューヨークで行われた映画祭「Tribeca Film Festival」で上映され,好評を博したものだという。

詳細なメイキングがビデオで公開されているので,興味がある人はそちらも見てほしい。

The Making of Hallelujah with Lytro Immerge from Lytro on VimeoLytro Immergeプロジェクトの成果物「Hallelujah」のメイキング映像

現在のLytro Immergeでは,約1mほどある六角形の平面上に敷き詰めた95個の4Kカメラで画角90度の映像を撮影したうえで,その撮影結果からシーンの深度情報(3次元の奥行き情報)を計算する。そしてVRコンテンツの再生時に,任意の方向,位置,傾きを持った左右の眼それぞれによる視線の映像を深度情報を加味したうえで抽出し,映像として合成して表示するということだった。

カメラからの映像をリアルタイムに処理するImmergeとVRWorks 360 Videoとは異なり,Lytro Immergeは,撮影映像の合成を事前計算で行う必要があるものの,再生時の映像合成はリアルタイムで行う。デモ機のシステムでは複数のPascal世代GPU(※GPU名は未公開)を複数使用して,この処理をリアルタイムに行っているということだった。

|

Hallelujahデモは基本的に,VR HMDを被った体験者が,教会の中に立って,主役であるオペラ歌手とバックの合唱隊が歌う様子を360度ビデオで見るというものだ。体験者は直径約1mほどの円内を自由に移動しながら,上下左右360度を好きなように見回すことができる。

面白いのは,主役のオペラ歌手が歌う声域に合わせて,彼の出現位置が変わるという点だ。たとえば,高音域を歌うときは合唱隊の前に立つような位置にいるが,中音域では体験者の右横,低音域では左後ろに出現するといった具合である。そして体験者は,自分の周囲に出現するオペラ歌手をさまざまな位置や角度から――移動できるのは約1mの円内だけだが――眺めることができるのだ。

つまり,合唱隊は実写の360度ビデオだが,オペラ歌手は別撮りした立体像で,それをリアルタイムに合成してVR HMDの映像として表示しているのである。

言葉ではイメージしにくいと思うので,編集部で作ったイメージ画像を掲載しておこう。中心にいる黄色の人物が体験者で,周囲にいる青い人物がオペラ歌手,体験者の足下にある円が移動可能な範囲となり,水色の円錐はVR HMDの視野を示す。背景は奥側にしかないが,実際はこれが360度全周にあるとイメージしてほしい。

|

背景には,パイプオルガンの置かれた美しい教会が360度全周に広がっているし,オペラ歌手の背後を覗き込もうとすれば,視界の動きに合わせて背後にある背景も見える。デモの本筋ではないが,ヘッドフォンによるサラウンドサウンド再生の定位も良好で,オペラ歌手の出現位置にうまく合わせて声が聞こえてくるので,没入感を高めるのに効果的だった。

GTC 2017のHallelujahよりも古いバージョンによるもののようだが,Lytroが公開した別のVRデモを扱ったビデオも掲載しておこう。前掲の画像とこのビデオを見れば,筆者が体験したデモを大雑把にイメージできるのではないだろうか。

VR Demo By Lytro from Lytro on Vimeo

|

いずれにせよ,実写映像の中をある程度の範囲とはいえ,3D立体視で動き回れるのは,なかなか新しい体験だった。今後の進化が楽しみな技術である。

Vive×Epic GamesブースではMcLarenの新車体験デモを披露

F1コンストラクターの名門にして,市販スポーツカーメーカーとして名高いイギリスの自動車メーカーMcLarenと,ゲームエンジン最大手であるEpic Gamesは,近年,協力関係を深めている。

実は,Epic Gamesの副社長にして共同設立者のMark Rein氏がMcLarenの大ファンで,生産台数375台限定のハイブリッドスポーツカー「McLaren P1」(※価格は約1億円)をはじめとして,McLaren車を4台も所有するほどの超マニアなのだ。

2016年にMcLarenが公開した新車「McLaren 570S」の予告映像も,Epic GamesがUnreal Engine 4で制作したという。GDC 2016のEpic Gamesブースで遭遇したRein氏は,ほくほくの笑顔でその映像を見せつけてきたほどで,本当にMcLarenとの関係を楽しんでいる様子だった。

|

|

そんなRein氏のリーダーシップもあってか,McLarenは,ディーラーにおいて顧客との商談に用いているバーチャルカスタマイズシステム「Configurator」に,Epic Games自体がUnreal Engine 4(以下,UE4)ベースで制作したシステムを利用しているという。きちんとビジネスにもつなげているわけだ。

|

デモに使っていたVR HMDは,HTCの「Vive」で,ルームスケールVRの利点を生かして,McLaren 720Sの周囲を自由に歩き回って,さまざまな角度から眺めたり,ドアのような一部の可動パーツを開け閉めしたりできる内容になっていた。

体験者と車体に接触判定はないのだが,それは意図的なものとのこと。内装やボンネット内部の細部までモデリングされているので,車の中に入ると,運転席に座ったような視点が楽しめるし,エンジンルームに頭を突っ込めば,エンジンブロック内部のピストンや各種補器類のパイピングを見て楽しめるのだ。

ちなみに,Vive専用コントローラを使うと,体験者の手元から煙を放出させて,VR空間を走行しているMcLaren 720Sの車体に沿って,風洞実験のように煙の流れが後部へと吹き抜けていく様子を体験できた。どこまで正確な表現かは分からないが,疑似的な風洞実験を体験できるのは,筆者のような車マニアには実に楽しい体験だ。……女性来場者にはあまり受けなかったようだが。

|

|

NASAが研究所を設立して取り組む「Hybrid Reality」とは?

仮想現実ことVRの延長線上にある技術として,拡張現実(Augmented Reality,AR)や複合現実(Mixed Reality,MR)といったものがある。前者はGoogleがARプラットフォーム「Tango」を展開しており,後者はMicrosoftが「Windows Mixed Reality」として,Windows 10の標準機能と取り込んだりといった具合に,製品への実装も進み始めているところだ。

2017年3月には,OpenGLのようなAPI規格の標準化団体であるKhronos Groupが,VR,AR,MRのすべてに対応するという触れ込みのAPI規格「OpenXR」を発表している。OpenXRは,「X」をワイルドカード的な文字としてあてがったわけだが,Realityの「R」と英字1文字を組み合わせた新しい技術……あるいは規格が登場しつつある。それが「HR」こと「Hybrid Reality」だ。

今ひとつ,いい訳語が思い浮かばないが,あえて言うなら「混合現実」といったところだろうか。

|

|

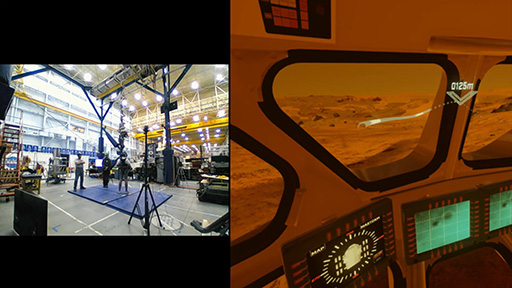

まだ公式WebページすらないらしいNHRLだが,なんとVR Villageにブースを出展していたから驚きだ。しかも,国際宇宙ステーションの訓練用VRコンテンツを体験できるとあって,連日予約でいっぱいというほどの大人気。筆者もなんとか最終日に体験できた次第だ。

|

|

NASAはもともと,宇宙飛行士の訓練用としてVR技術を研究していた。たしかに,視界に映る映像はリアルに再現でき,没入感も十分なのだが,問題となったのが機器の操作だという。現在あるViveや,Oculus VRの「Rift」では,ゲームパッドやモーションコントローラを使うしかなく,NASAが望むレベルの「訓練の正確さ」を再現するのが難しかったのだそうだ。

そこでNASAは,再現したい機器の大ざっぱな模型を3Dプリンターで生成し,その模型上に本物と同じようなスイッチ類を配置して,VRコンテンツ内で使えるようにしたところ,訓練の再現度が向上した手応えを得られたという。

この発想をさらに発展させて,国際宇宙ステーションの内部構造を,NASAが有する巨大な実験スタジオ内にアルミフレームなどで再現し,その内部には,3Dプリンターで再現した模型の機器を配置したり,ステーション内の移動時に捕まる取っ手などを再現したりしたうえで,訓練参加者をハーネス付きのベストで宙づりにして船内を体験させたところ,さらにリアリティが高まって訓練の再現度が向上したのだそうだ。

そんなこんなで現在のNASAでは,さまざまなシチュエーションのVR訓練プログラムや,3Dプリンターによる訓練用模型の作成を進めているという話だった。

|

|

|

|

NASAブースでは実際に,宇宙で使える電動ドライバーの模型を手に持ち,国際宇宙ステーションの内部を移動して,船内パネルを修理する訓練を体験できた。国際宇宙ステーションのグラフィックスは,外観から内部までリアルに感じられたのだが,これもまたUE4を使って作られているのとのことだ。

電動ドライバーの模型が非常に軽いことに驚いたのだが,「これは無重力下で使用することを想定して,あえて軽量にしているんだ。実物の外観とスイッチ類だけを再現すれば,実際の機能は仮想世界で実現すればいいというのが,HRのいいところだね」とブース担当者は説明していた。さらに,「火星や月といった地球上とは違う重力の環境を再現するにも,追加の錘を仕込むだけでいい」そうだ。目から鱗という感じである。

|

|

|

ちなみに,宙づりベストを着用した本物の訓練環境では,ステーション内の移動を滑車とレールのようなものを使って行うのだが,VR Villageでの簡易版では,Vive用のモーションコントローラを使い,ステーション内外を自由にテレポートして移動できるようになっていた。

まとめると,NASAが提唱するHRとは,「現実世界と仮想空間で,見て触れるものを一致させようとするVR」のようだ。2016年にお台場でスタートした6人同時参加型VRアトラクション「ZERO LATENCY VR」は,参加者が精巧に作られたガンコントローラを持ってプレイするVR体験だが,これもある種のHRといえるかもしれない。

|

HRという名前が定着するかどうかはさておき,将来のVR体験にはユーザーから仮想世界に触れた感触――接触感とでも言おうか――の表現が求められているのは間違いない。HRのアプローチは,それを実現する手段として有望であると思う。今後の発展に注目したい。

|

|

VRでさらに広がるゲームエンジンのノンゲーム用途での応用

最後に,GTC 2017全体の総括を短くまとめてみたい。

GTC 2017は,ゲーム分野に重点を置いたセッションや展示はほぼなくなってしまったが,リアルタイムグラフィックス技術のセッションはまだまだ多く,とくにVR関連のセッションや展示は,相変わらず多かったように思う。

また,今回紹介したNASAのHR体験もそうだが,基調講演で披露された多人数同時参加型のVR会議システム「Project Holodeck」や,ロボットAIを学習させるためのVRシミュレーションシステム「Isaac」といったゲームエンジン――具体的にはUE4――を使ったVRシステムの登場からも想像できるように,今後はノンゲーム用途におけるゲーム関連技術の活用として,GPUの応用はますます広がりを見せるのではないだろうか。

もう1つ興味深かったのは,実写系VRの実現に向けた取り組みが進んでいることだ。2Dのパノラマ映像を撮影できる360度ビデオカメラは,各社から製品が登場してそこそこの盛り上がりを見せているところだが,すでにその先を目指した技術として,360度映像のライトフィールド再現を目指した開発が進んでいることには,正直驚かされた。

スポーツやイベントを360度映像として放送したり,アーカイブしたりといった用途に有望な技術と思えるので,こちらも今後の発展にも期待したいところだ。

GTC公式Webサイト(英語)

- この記事のURL: