イベント

OculusのVR手描きツールからPSVR用インディーズゲームまで。注目のリアルタイムデモが登場した「Real-Time Live!」レポート前編

そこで本稿では,Oculus VR,NVIDIAのセッションや,新興ベンチャーが開発するAR(拡張現実)対応型ヘッドマウントディスプレイなどの話題をレポートしよう。

なお,RTLで行われたスクウェア・エニックスの「FINAL FANTASY XV」(PS4 / Xbox One,以下 FFXV)開発チームが行ったセッション「Real-Time Technologies of FINAL FANTASY XV Battles」(FINAL FANTASY XVの戦闘におけるリアルタイム技術)については,すでにレポート記事を掲載済みである。未見の人は合わせて参照してほしい。

絵画タッチのVR用短編映画制作ツールをOculus VRが実演

仮想現実(VR)ブームの火付け役であるOculus VRには,「Oculus Story Studio」(以下,Story Studio)というVRコンテンツ制作チームがある。

Story Studioは,チーム名に「Story」という単語があることからも分かるとおり,ゲームではなく「映画のような物語を楽しませる次世代のVRコンテンツ」を制作するチームであり,1作めとして「Lost」,2作めの「Henry」という短編VR映画を発表済みだ。

|

そのStory Studioは,3作めとなる「Dear Angelica」という,新しい短編VR映画を制作中だ。この作品は,すべての映像をStory Studio製のVRドローツール「Quill」(羽根ペンの意)で制作しているそうで,今回のセッションは,このQuillを使って実際にステージ上で絵を描く様子を実演するものだった。

Quillとは,VR HMD「Rift」の専用モーションコントローラである「Oculus Touch」を使い,VR空間で立体的な手書きの線を描くツールだ。線の太さや色は,当然ながら自由に選択でき,描いたすべての線分のストロークや描き順は,3Dベクトルデータとして記録されている。そのため,回転拡大縮小は自由自在。解像度は事実上無限大といってもいい。

今のところ,社内プロジェクト向けの内製ツールとして開発を進めている段階で一般向けのリリース予定はないとのこと。

|

|

さて,このツールで制作している短編映画のDear Angelicaでは,こうして描かれたキャラクターやオブジェクトが動き回って物語を紡ぐという。公式情報によれば,2016年内に公開予定とのことで,今から楽しみである。

NVIDIAはGameWorksの新機能「粘性・弾性材質の変形表現」を披露

RTLの常連であるNVIDIAは,新開発の物理シミュレーション技術「Real-time simulation of solids with large viscoplastic deformation」(大規模な弾塑性固体のリアルタイム変形シミュレーション)を実演した。技術開発を担当したのは,NVIDIA PhysX ResearchのNuttapong Chentanez氏とMatthias Müller-Fischer氏らのチーム。

余談だが,両氏はSIGGRAPH 2013のRTLで,プロシージャルな破壊を表現する「Massive Destruction in Real-Time」を公開したときのコンビでもある。

弾塑性固体とは,弾力と粘性を合わせ持った固体で,水を含んだ泥とか粘土のような粘っこくて変形しやすい物質のこと。ほおっておいても初期状態の形状を維持できるが,何らかの衝撃や圧力で変形しやすいものといったところか。

さて,今回発表された技術は変形だけでなく,強い衝撃や圧力を加えることで,破壊や切断までをシミュレーションできるところが特徴だという。

シミュレーションのアプローチはパーティクル法で,挙動の計算はパーティクル単位で行われる。用いる物理シミュレーション手法は「位置ベース」(Position Based Dynamics,以下 PBD)であるため,他の物体と接触することで,ブルブル震えたりすることはほぼない。

シミュレーションの最小単位はパーティクルだが,安定した部位のパーティクルは,複数まとめたクラスタ構造で管理してシミュレーションを行うという。変形や切断が起きたときには,このクラスタ単位を再構築し,切断面や変形面などの界面領域では最小単位のパーティクルでシミュレーションが行われるわけだ。

映像の途中で,デバッグ画面を見せているが,ここで,クラスタ化して管理しているパーティクルの様子と,切断面や変形面でパーティクルが増大する様子を確認できるだろう。

RTLでの実演では,モンスターや動物といったさまざまな形状のオブジェクトを,引き伸ばしたり切断したり,ほかのオブジェクトをぶつけたりする様子を披露して,来場者の笑いを誘っていた。

グラフィックスはボリュームレンダリングではなく,パーティクル集合体からポリゴンへの変換を経て描画しているので,比較的解像度の高い形状表現ができる。このパーティクル集合体からポリゴンへの変換には,「Shape Matching法」が利用されているとのこと。Shape Matching法とは,各パーティクルをポリゴンを構成する頂点のように扱って界面を生成する手法で,CEDEC 2011のレポート記事で説明しているので,詳しくはそちらを参照してほしい。

この弾塑性固体シミュレーションは,将来的にNVIDIAのゲーム開発支援ライブラリ「GameWorks」の新機能として提供されるそうである。現在は,論文のみが公開中だ(関連リンク,PDFファイル)。

ベンチャー企業が開発中の新型AR HMD「Meta 2」

VRブームほどではないかもしれないが,徐々に活用する技術や製品が増えてきて,盛り上がりを見せつつあるAR分野。このARを体験するARヘッドマウントディスプレイ(以下,HMD)として,有名なのはMicrosoftが開発している「HoloLens」だ(関連記事)。

もっとも,MicrosoftはHoloLensのことを,「複合現実(Mixed Reality,MR)対応デバイスである」と説明しているのだが,ARとMRの区別はいまだ明確な線引きが確立しているわけではない。

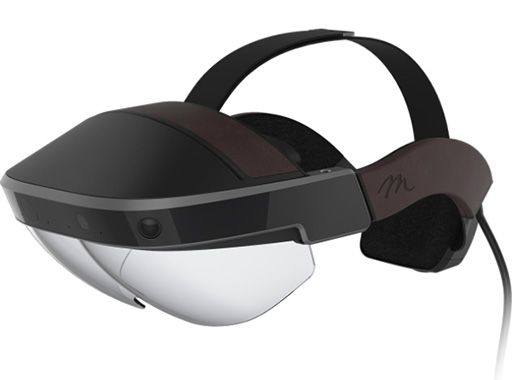

このHoloLensに近いコンセプトのAR HMDを開発しているのが,カナダのベンチャー企業,Meta Company(以下,Meta)である。今回のRTLでは,Metaが開発中のAR HMD「Meta 2」(関連リンク)の実演デモが行われた。デモを披露したのは,MetaのCTO(最高技術責任者)で共同創業者のRaymond Lo氏だ。

|

|

ただ,前側に出っ張ったボディの上部に映像パネルを配置して,それを目の前に来る半透明のバイザー部分に投影するという構造であるため,前側への張り出しが大きい。ただ,Lo氏はMeta 2独特な張り出しデザインを,「メガネをかけている人にはちょうどいい」と説明していた。

|

HoloLensとの最大の違いは,Meta 2そのものは,ただのディスプレイ装置だということ。HoloLensは単体でWindows 10が動作する機器なので,PCがなくても動作する。一方のMeta 2は,別途PCが必要なのだ。

Metaの公式サイトによれば,PCの必要スペックは,CPUが「Core i7-3610QM」以上,GPUが「GeForce GT 650M」以上とのこと。HoloLensもそうだが,ARはCG部分の表示負荷がVRほどではないので,それほど高い性能のGPUを要求していないのがポイントだ。

RTLのステージでは,ゲームエンジン「Unity」に対応するMeta 2用SDKを使い,ミニゲーム的なサンプルアプリケーションを実際にMeta 2でプレイする様子が披露された。

内容はごくシンプルで,ユーザーの手元に表示されるCGのブロックを手で拾って,ゴールとなる穴に放り込むバスケットボール的なものだ。動画を見ればどういうものかが分かるだろう。

デモ内容は地味であったが,CG世界側の3D空間とユーザーが見ている現実の3D空間がうまくマッチングできているようで,実物の手の位置や向き,動きに対し,CGが物理的に辻褄の合う挙動を示しているのが印象的であった。

Unity製の超リアルな短編映画「Adam」の舞台裏を公開

いまやゲームエンジンは,ゲームを制作するためだけのものではない。低予算,あるいは制作期間の短い映像制作プロジェクトで,ゲームエンジンを活用しようとする動きは活発になっている。こうしたニーズに応じるべく,Unreal EngineやUnityといったゲームエンジンでは,映像作品制作向けの機能を充実させているのだ。

とくに熱心なのはUnity Technologiesで,2012年に「The Butterfly Effect」,2015年には「The Blacksmith」という,Unityを使ったリアルタイムグラフィックスによる短編映画を公開したことがある。GDC 2016では,Unity Technologiesの展示ブースで映像制作用途をアピールするデモも行われていた(関連記事)。

そして2016年に公開したのが,新作の短編映画「Adam」である。

Unity Technologiesによるステージでは,実際にAdam本編の映像を上映しつつ,制作にまつわる裏話が語られた。

まずAdamは,同社が開発に取り組んでいる「シネマティックシーケンサー」を用いて制作したのだという。これは,映像編集ソフト風にタイムラインベースでのCG映像制作が可能なツールだ。

Unity 5が採用した物理ベースレンダリング(Physically Based Rendering)は,非常にリアルな素材感を表現できる。Adamでは,これを被写界深度表現によるボケ味を巧みに使った映画的な演出と組み合わせることで,リアルタイムグラフィックスには見えないクオリティを実現しているという。その成果は,Adam本編の映像を見れば一目瞭然だろう。

それ以外にも,複雑な面形状を持った光源からのライティングを実現するという,新しいエリアライティング手法も活用しているとのこと。この新エリアライティングのテクニックは,Unity Technologiesが「Real-Time Polygonal-Light Shading with Linearly Transformed Cosines」(関連リンク)として,

Adamに登場するキャラクターのアニメーション設定や,布のシミュレーション,ロープやパイプ,ケーブルといった紐状オブジェクトの表現も,Unity向けの物理ベースのアニメーションツール「CaronteFX」(関連リンク)で制作しているそうだ。

さてセッションの最後には,3Dのシーンに対して,背景となるオブジェクトを簡単かつ自然に配置するためのミニツールが紹介された。

葉っぱや枯れ木,石,岩といったオブジェクトを,適当にシーン内で放り投げると,物理シミュレーションによってオブジェクト同士や地形とぶつかり合って跳ねたり,あるいは折り重なったりして,自然な感じで配置できるというものだ。手作業で岩や葉っぱを配置していくよりも手間は少なく,それでいて配置もリアルになるので,一石二鳥といえるだろう。

ゲームエンジンで映像作品を制作するという用途では,ライバルのUnreal Engine 4に大きく水をあけられていた感じもなくはなかったUnityだが,ここに来て一気に追いついてきたという印象を受けた。Adamの映像は,映像制作者必見といってもよさそうだ。

プロシージャルグラフィックスを駆使するPSVR対応アクション「Bound」

2016年6月に開かれたE3 2016のソニーブースでは一風変わったPlayStation 4用ゲームが話題を呼んでいた。

そのゲームは「バウンド:王国の欠片」(以下,Bound)。独特の謎めいた世界観と孤独なプレイ感覚が,日本でも高い評価を受けた「風ノ旅ビト」に似ていると評判になり,注目が集まりつつあるタイトルだ。PlayStation VR(以下,PSVR)にも対応する予定である。

|

ゲーム内容は,サードパーソンタイプのアクションゲームで,キャラクターを操作して,足場をジャンプで飛び越えていくタイプのタイトルだ。攻撃のような操作はなく,ボタン操作で華麗なダンスを踊ることで,ゲーム世界を探索していく。

|

|

開発元のPlasticは,いわゆるインディーズゲーム開発チームである。公式WebサイトのURLは「http://plastic-demo.nazwa.pl/」で,demoという文字列が見られるように,出自はいわゆるメガデモ制作チームであるとのこと。

メガデモは,一定の容量制限内で,グラフィックスや音楽を含んだランタイムの映像デモを表現するコンテンツだ。少ないデータ量から,できるだけリッチな表現を行うことが高い評価につながる世界なので,ある意味では,プログラミング技術を競う競技的な側面を持つ。

余談だが,「Max Payne」や「Alan Wake」「Quantum Break」の開発元であるRemedy Entertainmentも,創設メンバーはメガデモ出身のエンジニア達であるという。とくに欧州では,出自がメガデモというゲーム開発スタジオは少なくない。

そんなメガデモ出身のPlasticが得意とするのは,プロシージャル技術だ。Boundでも,ゲーム世界におけるかなりの要素をプロシージャル技術で生成しているという。

今回のセッションでは,バレリーナが踊ったり動いたりすることで反応するゲーム世界のアニメーションなどに,プロシージャル技術が使われていることを解説していた。

|

アート集団でもある彼らは,Boundのコンセプトに「Neoplasticism」(新造型主義),「Suprematism」(絶対主義),「Concretism」(具体主義)の3つを掲げていたが,アートの世界には疎い筆者には,いまいちピンとこなかったのが正直なところ。ただ,セッションでは,その独特なビジュアル表現に大きな拍手が贈られていた。

8月16日にPlayStation Networkにて発売予定なので,興味のある人はチャレンジしてみてはいかがだろうか。

Real-Time Live! ― SIGGRAPH 2016

4GamerのSIGGRAPH 2016レポート記事一覧

- 関連タイトル:

バウンド:王国の欠片

バウンド:王国の欠片

- 関連タイトル:

Unity

Unity

- この記事のURL:

キーワード

- イベント

- ムービー

- Oculus VR

- NVIDIA

- VR

- AR

- ライター:西川善司

- SIGGRAPH 2016

- :バウンド:王国の欠片

- HARDWARE:Unity

- HARDWARE

- Unity Technologies

(C)Sony Interactive Entertainment America LLC. Developed by Plastic.